Máy bạn chạy được AI nào? Dùng CanIRun.ai để biết ngay

Bạn nghe nói có thể chạy Llama, DeepSeek hay Qwen ngay trên máy tính cá nhân — không cần API, không tốn tiền mỗi tháng. Nghe hấp dẫn. Nhưng rồi bạn tải về, mày mò cài đặt, và kết quả là máy đứng hình hoặc chạy chậm đến mức không dùng được.

Lý do không phải bạn làm sai. Lý do là bạn chọn sai model cho phần cứng của mình.

CanIRun.ai giải quyết đúng vấn đề đó.

CanIRun.ai là gì?

CanIRun.ai là công cụ online giúp bạn biết ngay máy tính của mình có thể chạy được những AI model nào — và chạy ở mức nào: mượt, tạm ổn, hay không nên thử.

Cách hoạt động đơn giản: bạn truy cập website, tool tự động đọc thông số phần cứng của máy qua trình duyệt (GPU, VRAM, RAM, bandwidth bộ nhớ), rồi đối chiếu với toàn bộ danh sách model trong database. Kết quả hiện ra ngay — từng model được xếp hạng từ S (chạy mượt) đến F (máy chịu thua).

Không cần cài phần mềm. Không cần tạo tài khoản.

Tại sao đây là thông tin bạn cần trước khi làm bất cứ điều gì

Giả sử bạn muốn chạy DeepSeek R1 — model reasoning đang được nói đến nhiều. Nghe tên thì hoành, nhưng phiên bản full có 671B parameters, cần tới 344GB VRAM để chạy. Ngay cả RTX 4090 (24GB VRAM) cũng không đủ.

Trong khi đó, DeepSeek R1 Distill 32B — phiên bản nhỏ hơn, chưng cất từ bản gốc — chỉ cần khoảng 17GB. Máy có 16GB RAM + GPU tầm trung là chạy được, dù chậm hơn.

Nếu không biết điều này trước, bạn sẽ mất vài tiếng tải về rồi nhận kết quả: không chạy được.

CanIRun.ai cắt bỏ bước đó.

Cách dùng CanIRun.ai

Vào canirun.ai — tool tự detect GPU và RAM của bạn ngay trên trình duyệt

Xem danh sách model được lọc theo phần cứng của bạn

Lọc thêm theo: task (chat, code, reasoning, vision), nhà cung cấp (Meta, Google, DeepSeek, Mistral...), license (có được dùng thương mại không)

Sort theo tốc độ, kích thước, độ phổ biến, hoặc VRAM cần thiết

Mỗi model hiển thị rõ:

Dung lượng cần thiết (GB)

Context window (bao nhiêu token)

Các mức quantization có sẵn (Q4, Q6, Q8, F16...)

Task phù hợp

Một số model phổ biến và ngưỡng phần cứng thực tế

ModelVRAM tối thiểu (Q4)Phù hợpLlama 3.1 8B~5GBMáy phổ thông, laptop gaming tầm trungPhi-4 14B~8GBGPU RTX 3060 trở lênQwen 2.5 Coder 32B~17GBRTX 3090 / 4090Gemma 3 27B~14GBHigh-end consumer GPUDeepSeek R1 Distill 32B~17GBRTX 3090 / 4090

Nếu RAM máy bạn chỉ có 16GB và không có GPU rời mạnh, đừng cố với các model 32B trở lên. Tập trung vào nhóm 7B–14B — vẫn rất tốt cho coding và chat.

Quantization là gì và tại sao nó quan trọng

Khi bạn thấy ký hiệu Q4_K_M, Q6_K, F16 bên cạnh tên model — đó là mức quantization, tức là cách nén model để nhẹ hơn.

F16: Full precision — đầy đủ nhất, nặng nhất

Q8_0: Nén 8-bit — gần như không mất chất lượng, nhẹ hơn 50%

Q4_K_M: Nén 4-bit — phổ biến nhất cho máy consumer, chất lượng vẫn tốt, nhẹ hơn nhiều

Q2_K: Nén mạnh nhất — nhẹ nhất nhưng mất khá nhiều chất lượng

Nói đơn giản: nếu máy bạn không đủ VRAM để chạy F16, thử Q4 trước. Với phần lớn tác vụ thực tế, Q4 và Q8 khác biệt không đáng kể.

Khi nào nên chạy AI local thay vì dùng API?

Đây là câu hỏi thực tế hơn "máy tôi có chạy được không":

Bạn xử lý dữ liệu nhạy cảm không muốn gửi lên cloud

Bạn cần chạy offline — không phụ thuộc internet

Bạn muốn kiểm soát hoàn toàn model, context, không bị rate limit

Chi phí API của bạn đang tăng đều mỗi tháng và muốn cắt giảm

Nếu bạn chỉ cần chat thông thường hoặc prototype nhanh, API vẫn tiện hơn. Nhưng nếu bạn đang xây dựng sản phẩm nghiêm túc — biết máy mình chạy được gì là thông tin cần có từ đầu.

Kết luận

Trước khi tải bất kỳ AI model nào về máy, hãy mở canirun.ai ra kiểm tra trước. Mất 30 giây, tiết kiệm vài tiếng mày mò.

Nếu bạn đang tìm hiểu cách chạy AI local để xây dựng sản phẩm hoặc workflow cá nhân, TEDU có các nội dung thực hành đi từ setup đến tích hợp vào ứng dụng thực tế — theo dõi kênh để không bỏ lỡ.

Bài viết liên quan

BMAD Framework: Review Thực Tế Sau Khi Áp Dụng Vào Dự Án

BMAD Framework là gì và hoạt động ra sao trong thực tế? Review từ TEDU sau khi áp dụng vào dự án AI Driven Development — từ agent team đến docs-as-code.

Đọc thêm

Làm việc với Claude AI hiệu quả: 4 tầng bạn cần setup

Muốn Claude AI thực sự hữu ích? Chỉ nhắn tin thôi chưa đủ. Bài này hướng dẫn 4 tầng setup từ cơ bản đến nâng cao, kèm ví dụ thực tế cho developer và indie hacker.

Đọc thêm

Xây dựng trợ lý AI (Copilot) bằng cách sử dụng Semantic Kernel framework với C#.NET

Semantic Kernel (SK) là một SDK mã nguồn mở, giúp bạn dễ dàng xây dựng các AI agent có thể gọi code hiện có của bạn. SK hỗ trợ các model từ OpenAI, Azure OpenAI, Hugging Face, v.v.

Đọc thêm

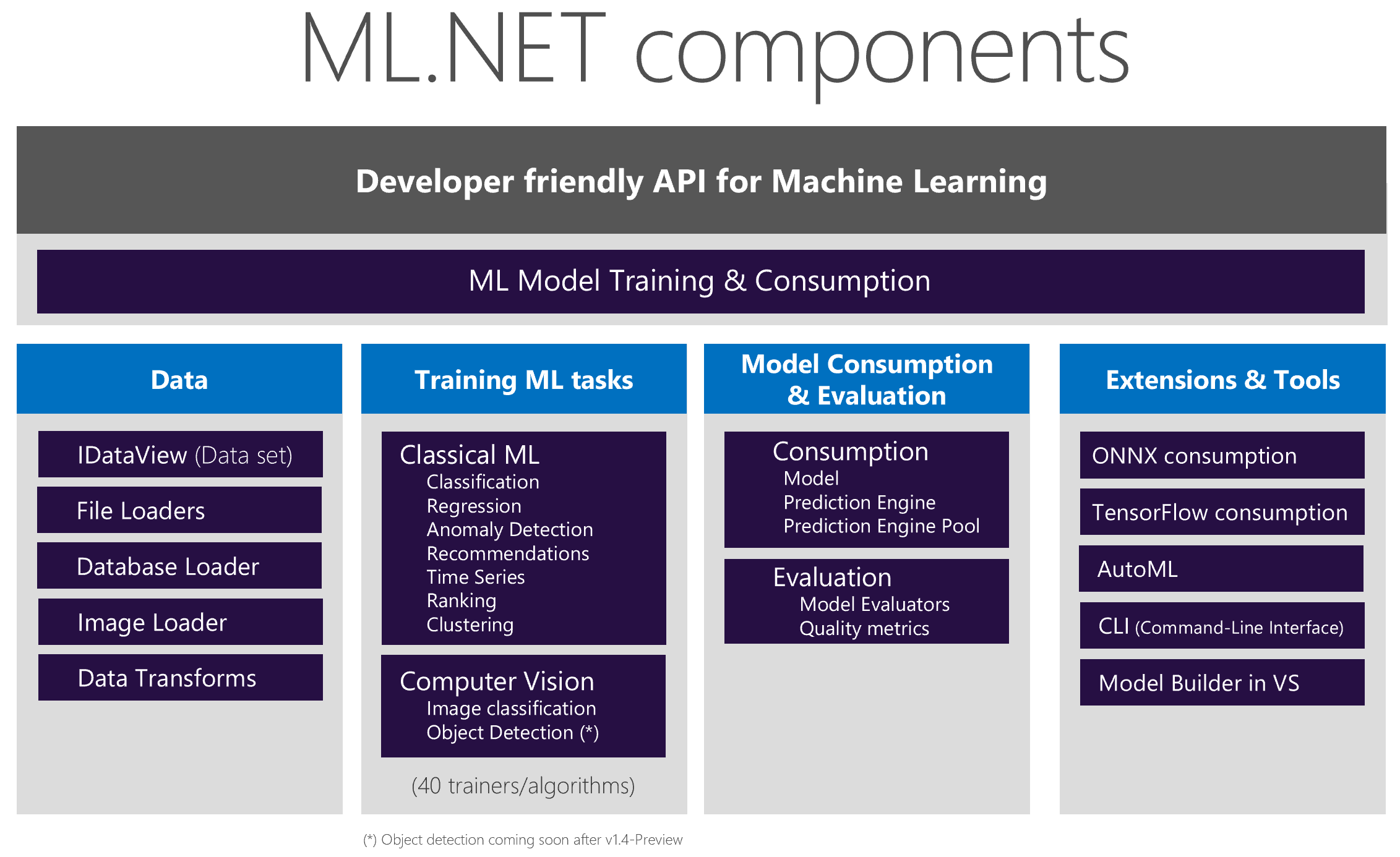

Bài 1: ML.NET là gì? Tổng quan về Machine Learning trong .NET

ML.NET là một framework Machine Learning dành riêng cho .NET, giúp các lập trình viên C# có thể xây dựng mô hình ML một cách dễ dàng mà không cần kiến thức chuyên sâu về AI.

Đọc thêm

Cách Sử Dụng Trí Tuệ Nhân Tạo (AI) trong Business Analytics

Trong bài viết này, chúng ta sẽ khám phá sức mạnh của trí tuệ nhân tạo (AI) trong lĩnh vực Business Analytics và cách nó đã thay đổi cách chúng ta hiểu và thực hiện phân tích dữ liệu.

Đọc thêmKhám phá Phind: Đối tác lập trình AI hoàn hảo và hoàn toàn miễn phí

Giới thiệu công cụ AI Phind, một trợ lý lập trình miễn phí giúp viết mã nhanh chóng và hiệu quả dựa trên ngữ cảnh và ý định của mã bạn đang viết.

Đọc thêm

Khám phá GitHub Copilot: Đối tác lập trình AI tốt nhất hiện nay

Hướng dẫn sử dụng công cụ AI lập trình Github Copilot thông qua Visual Stdio Code

Đọc thêm